推荐文章

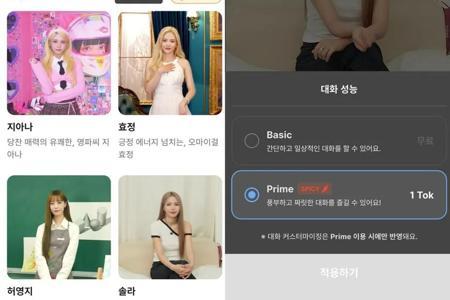

AI“辣聊”翻车,谁在允许偶像被“分身擦边”?

11月前

•

AI热点

速抢(2核2G)77元/年香港免备案服务器

0秒前

•

视频教程

SAP 与阿里巴巴集团达成战略合作,探索接入通义千问大模型

11月前

•

AI热点

商汤林达华:破解图文交错思维链技术,商汤的“两步走”路径

8月前

•

AI热点

快手副总裁、大模型负责人张迪将离职|新皮层独家

8月前

•

AI热点

字节跳动重磅推出豆包1.6与 Seedance1.0,成本大幅降低

11月前

•

AI热点

Hinton预言成真,AI接管美国一半白领,牛津哈佛扎堆转行做技工

8月前

•

AI热点

华为云新一代昇腾 AI 云服务全面上线:首创将 384 颗昇腾 NPU 和 192 颗鲲鹏 CPU 全对等互联

10月前

•

AI热点

热门作者

AI前沿

2.4k 粉丝

机器学习实验室

1.8k 粉丝

AI创业圈

3.1k 粉丝