又快到了一年一度新 iPhone 的发布时间。

就在昨天,X 平台上曝出了一张疑似苹果秋季新品发布会的邀请函,指明了今年的秋季新品发布会将于当地时间 9 月 9 日上午 10 点(对应北京时间 9 月 10 日凌晨 1 点),在苹果总部 Apple Park 的史蒂夫·乔布斯剧院举办。而活动主题「Futurebound」作为一个生造词,大抵可以翻译成面向未来、未来之旅等。

尽管从时间、地点到主题,这些信息都在常理范围内,但考虑到苹果以往都是 8 月下旬给到邀请函,加之泄露邀请函的账号很快就在 X 平台上注销,所以这些活动信息还「不保真」。

相比之下,苹果最新测试版系统中的部分代码,几乎把近期重要新品的芯片信息都泄露了出来,足以堪称苹果史上最大泄露事件之一,推翻了之前的一些传闻,也证实一些爆料。

图片来源:X

就拿即将发布 iPhone 17 系列来说,MacRumors 研究员 Aaron Perris 目前已经基本确认 iPhone 17 Air 以及后续的 iPhone 17e都会搭载苹果自研的 Apple C1 基带芯片,而下一代 Vision Pro 的主芯片则将从 M2 升级到 M5。

此外,苹果也把芯片成本「分摊」到了极致,除了 iPhone 17 Pro 将采用 A19 Pro外,下一代 Studio Display 和 iPad mini 也都将搭载 A19 Pro 这款为手机设计的芯片。考虑到今年还有一款搭载 A18 Pro 的入门款 MacBook,或许明年 A19 Pro 同样也会引入 MacBook 产品线。

官方泄露无遗,苹果芯片没有秘密

尽管 9 月 9 日的发布时间还无法确认,但考虑到苹果秋季新品发布会的时间都在 9 月第二或者第三周,距离发布会都剩下不到一个月。而系统代码中的信息,更是让 iPhone 17 系列的芯片布局几乎没有悬念。

iPhone 17 Pro / Pro Max 将首发 A19 Pro,延续 Pro 系列芯片先行的策略。A19 Pro 预计会在 CPU、GPU 及神经网络引擎(NPU)全面迭代,尤其是 AI 推理能力,支撑 Apple Intelligence(苹果智能)新功能更高的本地计算需求。

从代码的信息挖掘来看,继 iPhone 16e 之后,iPhone 17 Air 以及作为明年春季的补位机型——iPhone 17e,都将继续搭载苹果自研 Apple C1 基带,进一步摆脱对高通基带的依赖。反过来看,iPhone 17 系列其他机型可能暂时不会从高通基带切换到自家基带。

不过苹果没有更进一步扩大使用 C1 基带的原因,未必在于技术因素。从 2023 年苹果和高通签署的「三年协议」来看,我们应该要等到 2027 年才会看到 iPhone 全系采用自研 C 系列基带芯片。

图片来源:苹果

而 C1 的意义也不仅是成本和体验可控,同样重要的是与苹果自研的 Wi-Fi/蓝牙芯片形成功耗优化和延迟控制的统一方案。

正如此前雷科技报道,这次苹果的代码也再次证实了将于年内发布的新款 Apple TV,不仅将采用 iPhone 15 Pro 同款的 A17 Pro 芯片,并将首次搭载苹果自研的 Wi-Fi/蓝牙芯片。目前来看,这一轮 Apple TV 升级的关键不仅是为了画质和游戏,更是为了让 Apple TV 成为家庭 Apple Intelligence 的中枢节点——在大屏上运行更丰富的 AI 功能,同时提升多设备协同体验。

另外,新款 HomePod mini 搭载的处理器被证实将采用 S9/S10(用于 Apple Watch)同款的 T8310 核心,推测是与下一代 Apple Watch 共用 S11。但无论如何,可以肯定新款 HomePod mini 的处理器性能和能效都会比 S5 芯片强上很多。而据之前的消息,新款 HomePod mini 也很可能采用苹果自研 Wi-Fi/蓝牙芯片,支持 Wi-Fi 6E。

除了以上新品都预计在今年发布,还有一款重磅产品最早也将在今年年底发布,这就是下一代 Vision Pro。不同于此前彭博社 Mark Gurman 之处的搭载 M4 芯片,最新代码信息显示,下一代 Vision Pro 将从之前的 M2 芯片直接升级到采用台积电 N3P 工艺的 M5 芯片。

结合 Vision Pro 负责人 Mike Rockwell 已经接管全新 Siri 开发的消息来看,背后可能也是 Vision Pro 在渲染、空间感知和 AI 计算上的同时提速,或许下一代将在交互上会迎来大的升级。

Mike Rockwell,图片来源:苹果

此外,原本专为 iPhone 设计的 A 系列芯片也在 Apple Silicon(苹果自研芯片)版图中越发重要。按照代码信息来看,除了 iPhone 17 Pro 的 A19 Pro,最早明年春天发布的新一代 Studio Display 和 iPad mini 也被证实会用上这颗移动 SoC。

苹果过去更倾向为大尺寸设备定制不同版本的处理器,但现在显然在尝试通过统一芯片平台来摊薄成本,并让产品更新节奏更灵活。考虑到今年还有一款搭载 A18 Pro 的入门款 MacBook,不排除明年 A19 Pro 也会直接进入 MacBook 产品线,进一步模糊 A 系列与 M 系列的界限。

一切为了 AI?苹果芯片释放出三大信号

如果只看代码泄露里的新品名单,可能会觉得这是一次「信息量很大」的剧透。但把这些零散的型号、芯片和发布时间放在一起,其实也发现背后隐藏的一些信号,也是 Apple Silicon 正在经历的变化。

其一,是 A 系列的界限正在被刻意模糊。过去,A 系列是 iPhone 和部分 iPad 的专属,而 M 系列则是 Mac、iPad Pro 和 Vision Pro 等高性能设备的标志。但从最近两年的排布来看,这条界限已经被有意打破:

A19 Pro 将不仅用于 iPhone 17 Pro、iPad mini,还会直接进入 Studio Display 这样的大屏设备,而今年的入门款 MacBook 预计将搭载 A18 Pro,明年也可能升级到 A19 Pro。

这背后的逻辑一方面是通过统一架构减少设计和验证成本,提升量产规模。其次,用一颗芯片横跨多品类,能让苹果更灵活地控制产品更新节奏,比如用新款 iPhone 的芯片快速更新一批非旗舰产品线,既降低延迟也稳定性能表现。

图片来源:苹果

长远看,这种融合可能会让「移动芯片」和「桌面芯片」的概念在苹果体系内逐渐消失,剩下的只是不同尺寸和功耗下的 Apple Silicon。

其二,苹果正在摆脱高通、博通的依赖,打造无线技术闭环。

除了正在开发测试的 Apple C2 基带,新款 Apple TV 和 HomePod mini 将首发带来苹果自研的全新 Wi-Fi /蓝牙芯片。它们的共同特征是网络连接对使用体验来说至关重要,同时硬件结构相对简单,方便做大规模测试。

而这两条新晋「自研芯片」线,核心战场当然不是电视盒子和智能音箱。一旦 iPhone、iPad、Mac 等核心设备都切换到自研基带和连接芯片,苹果就能在整个生态内统一无线协议栈,从底层掌握延迟、功耗和稳定性的改造可能。

关键在于,摆脱对高通、博通的依赖不仅意味着供应链的独立性,还为苹果在多设备协同上提供了独一无二的优化空间。

图片来源:苹果

想象一下,当 AirPods、Mac、Apple Watch、HomePod、Apple TV 全部运行同一套自研无线架构时,跨设备无缝切换、低延迟投屏、甚至本地化的 AI 计算任务分发,都能在几乎无延迟的条件下完成。这种「底层闭环」是苹果生态过去、现在和未来最坚固的基础设施之一。

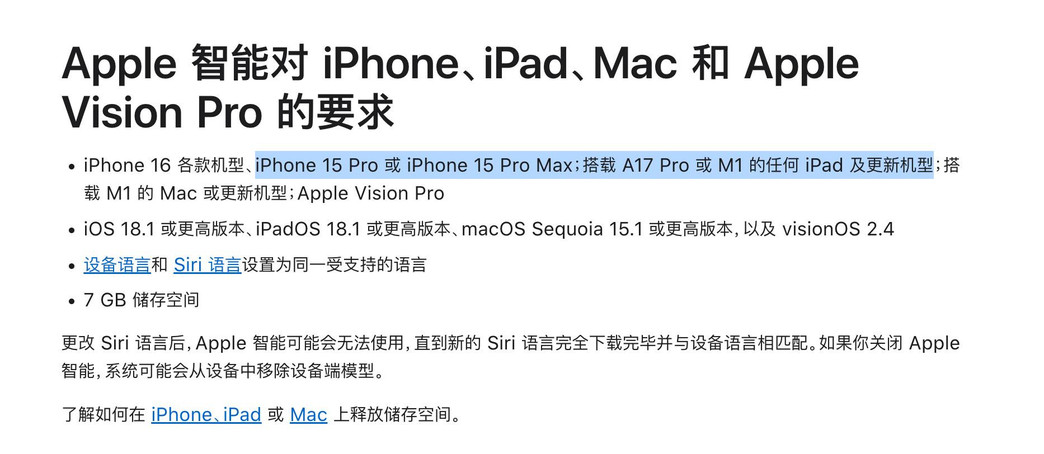

而其三,也是更关键的一点——Apple Intelligence 的硬件门槛正在被下放。

不管是 A19 Pro 用在新款 Studio Display,还是 A17 Pro 出现在 Apple TV 上,意义都不止性能提升。A17 Pro 具备足够的 AI 加速性能,可以直接运行苹果新一代的本地 AI 功能,这标志着 Apple Intelligence 不再是 iPhone 、iPad 以及 MacBook 等核心计算设备的「特权」,而是开始向更多品类、更多价位段的设备扩散。

最直接的证据就是,Apple Intelligence 对于硬件设备的最低要求就是搭载 A17 Pro 的设备。

图片来源:苹果

而这种下放,一方面可以通过硬件升级提前铺好跑 Apple Intelligence 的「算力底线」,确保未来功能发布时能覆盖尽可能多的存量和新增设备;另一方面,把 AI 中枢从单一设备延伸到整个家庭或办公空间,比如让 Apple TV 成为 AI 交互中心之一,让 HomePod 变成全屋的 AI 语音交互入口。

可以预见,Apple Intelligence 的迭代,将会伴随着苹果更多非核心计算设备上部署具备一定本地 AI 能力的芯片,让它们不只是接收指令,而是能在一定程度进行本地的自主执行、分析甚至决策。

写在最后

从 iPhone 17 到 Vision Pro,再到 Apple TV 和 HomePod mini,这次系统代码泄露的内容几乎把未来一两年的苹果芯片版图都摊开在了台面上。但看似只是几款新品的芯片信息,其实也在映射苹果在产品线融合、自研底层、AI 普及化上的布局。

可以肯定的是,未来的 Apple Silicon 将不再是单一产品的性能标签,而可能是整个生态的「隐形操作系统」,支撑着硬件形态、交互方式乃至使用场景的持续演化。至于这种演化会在多大程度上改变用户的日常体验,需要苹果给出答案。